L'Acer Swift Go 16 AI, con 16 GB di RAM e un AMD Ryzen 7 350, è stato recentemente sottoposto ai nostri test. L'aggiunta "AI" nel suo nome suggerisce che questo portatile è pronto per le applicazioni AI. La nostra recensionetuttavia, suggerisce che la memoria potrebbe essere piuttosto sottodimensionata per questo utilizzo. Tuttavia, i modelli linguistici, i generatori di immagini e gli strumenti video stanno diventando sempre più potenti e richiedono comunque meno RAM. Sulla carta, alcuni modelli di AI interessanti potrebbero funzionare con la memoria del portatile. Li abbiamo messi alla prova.

L'ultima versione di Windows 11 include già diversi strumenti di AI, alcuni dei quali vengono eseguiti localmente e altri sui server Microsoft. Purtroppo, non è sempre chiaro da dove Copilot e altri traggano la loro potenza di calcolo. L'app Copilot richiede costantemente una connessione internet attiva. Alcune funzioni dell'app Foto funzionano localmente senza una connessione internet, mentre altre richiedono un account Microsoft e non funzionano offline. I miglioramenti della qualità dell'immagine e dell'audio dalle registrazioni della webcam sono gestiti localmente tramite la NPU (Neural Processing Unit). È stata reintrodotta anche la funzione Recall di Microsoft, che ha suscitato qualche polemica. Tuttavia, rimane disattivata per impostazione predefinita e può essere utilizzata solo quando sono attivate la crittografia del dispositivo e la protezione con password. Molte altre funzioni AI in Windows non sono particolarmente evidenti o funzionano solo con Microsoft Office.

Per utilizzare i modelli linguistici alternativi e gli strumenti di generazione di immagini a livello locale, è necessario un software specifico. Tuttavia, il processo per far funzionare questi programmi sul computer di casa non è più così complicato come lo era solo un anno fa. Ora è disponibile un software semplice per entrambi, che si installa rapidamente e apre molte possibilità all'utente. Amuse offre un software per la generazione e l'editing di immagini AI, specificamente adattato all'hardware AMD dell'Acer Swift Go 16 AI. LM Studio offre un modo comodo per utilizzare gli SLM (small language models) - essenzialmente AI per la generazione di testi. FastFlowLM non è altrettanto comodo da usare, ma funziona in modo più efficiente dal punto di vista energetico sulla NPU. Abbiamo installato tutti e tre i programmi sul nostro dispositivo di prova. Tuttavia, l'Acer Swift Go 16 AI che abbiamo utilizzato non è purtroppo equipaggiato in modo ottimale con soli 16 GB di memoria. Windows e i programmi Acer preinstallati consumano rapidamente da sei a nove gigabyte della memoria limitata. Questo lascia circa 10 GB di memoria disponibile per l'AI. Amuse determina che circa 8 GB di memoria sono utilizzabili. LM Studio stima 15 GB, ma si blocca ogni volta che cerchiamo di caricare un modello linguistico sufficientemente grande.

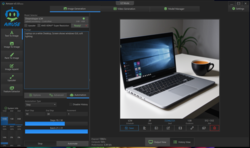

AMUSE - Modifica e generazione di immagini AI

Stavamo utilizzando Amuse nella sua ultima versione al momento del test (3.1). Il software è gratuito e si installa comodamente. Qui è supportata la NPU del processore AMD, che dovrebbe accelerare notevolmente il lavoro con l'AI, anche senza una GPU dedicata. Oltre alla generazione da testo a immagine, offre anche funzionalità da immagine a video e da immagine a immagine.

Per generare effettivamente le immagini, deve prima installare Amuse e poi caricare i modelli appropriati. Questo si ottiene utilizzando il programma, che è relativamente semplice ma richiede molto tempo, perché ogni modello contiene diversi gigabyte di dati. Delle tre preimpostazioni offerte da Amuse in modalità principiante, l'opzione "Bilanciato" non funziona per noi. le modalità "Veloce" e "Qualità", invece, funzionano, anche se solo la modalità veloce funziona davvero senza problemi. La modalità "Veloce" si basa sul piccolo Dreamshaper LCM Turbo. Si adatta bene alla memoria limitata del portatile e funziona molto rapidamente. Le immagini vengono generate in pochi secondi. In modalità esperto, funzionano anche StableDiffusion XL Turbo e StableDiffusion 3. Quest'ultimo può anche essere scaricato. Quest'ultimo può anche essere scaricato sulla NPU. Ma entrambi i modelli utilizzano completamente la memoria del portatile e non funzionano in modo rapido. L'utilizzo della memoria è particolarmente problematico quando Amuse è in esecuzione, e nient'altro sul portatile funziona senza problemi. In casi gravi, Amuse si blocca persino se una finestra del browser in background richiede troppa memoria. Solo l'utilizzo del piccolo Dreamshaper LCM è piacevole. Eppure, produce risultati relativamente buoni. Tuttavia, le sue radici sono chiaramente visibili in Stable Diffusion 1.5. Se non presta molta attenzione ai suggerimenti, vedrà molti bordi sfocati e strane proporzioni. Ma Dreamshaper LCM è anche incredibilmente veloce. In un batter d'occhio, questo modello può creare immagini. Qui la quantità è prioritaria rispetto alla qualità. Una volta che un'immagine è già ragionevolmente passabile. La qualità può essere ulteriormente migliorata in Amuse con l'editing da immagine a immagine.

I nostri Top 10

» Top 10 Portatili Multimedia

» Top 10 Portatili Gaming

» Top 10 Portatili Gaming Leggeri

» Top 10 Portatili da Ufficio e Business economici

» Top 10 Portatili Premium da Ufficio/Business

» Top 10 Portatili sotto i 300 Euro

» Top 10 Portatili sotto i 500 Euro

» Top 10 dei Portatili Workstation

» Top 10 Subnotebooks

» Top 10 Ultrabooks

» Top 10 Convertibili

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Smartphones

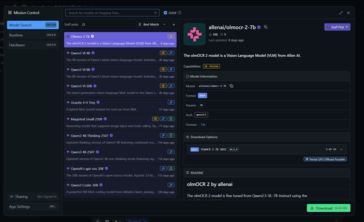

LM Studio - Chatbot, modelli di ragionamento e altro ancora

LM Studio è un sistema di gestione ed esecuzione di modelli linguistici. Sul portatile, i derivati di ChatGPT, Llama, Qwen3 e altri possono essere eseguiti localmente. Come per Amuse, il fattore limitante per Acer Swift Go 16 AI sembra essere la scarsa memoria, piuttosto che la potenza di elaborazione. Il nuovo gpt-oss 20B di OpenAI si blocca durante il caricamento a causa della memoria insufficiente. In base all'esperienza, possiamo confermare che il modello funziona perfettamente sui computer portatili con AMD Ryzen 9 370 e 32 GB di memoria.

Qwen3 Vi 8B, Qwen3 4B Thinking e Granite 4 H Tiny di IBM (Q4_K_M e Q8_0) funzionano sorprendentemente bene sul laptop Acer. Il modello linguistico più piccolo di IBM è straordinariamente veloce e brilla con risposte sufficienti. Qwen3 Vi 8B colpisce per il tono molto naturale del suo discorso e dimostra particolari qualità nell'elaborazione delle immagini. Per le persone con una vista ridotta, questa AI potrebbe fornire una grande assistenza su un computer portatile. Il modello di ragionamento Qwen3 4B Thinking è il più lento nei nostri test quando si tratta di risposte puramente testuali. Ma soprattutto, le risposte impressionano. A seconda della complessità della domanda, possono essere necessari fino a cinque minuti per ricevere una risposta da Qwen3. Naturalmente, può osservare il processo di riflessione e intervenire immediatamente se la risposta va completamente nella direzione sbagliata.

Anche molti altri modelli linguistici più piccoli dovrebbero funzionare bene sul nostro dispositivo di prova. Tuttavia, ogni modello linguistico consuma anche una quantità significativa di spazio sull'SSD. Dovrebbe aspettarsi da 3 a 7 GB per ogni modello linguistico. I piccoli SLM (Small Language Models) si rivelano sorprendentemente versatili.

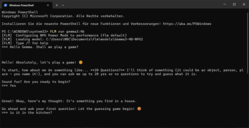

AI on Go - FastFlowLM con supporto completo AMD-NPU

Chi utilizza LM Studio in viaggio, purtroppo dovrà essere pronto ad affrontare un rapido esaurimento della batteria. LM Studio utilizza sia la CPU che la GPU per tutti i calcoli. La NPU ad alta efficienza energetica del nostro Ryzen 7 350 purtroppo non è stata toccata. FastFlowLM consente di sfruttare le prestazioni della NPU del chip AMD. Questo comporta un consumo energetico significativamente inferiore, nonostante gli LLM non funzionino in modo sensibilmente più lento sulla NPU. La qualità delle uscite rimane invariata. Tuttavia, FastFlowLM è leggermente più difficile da usare rispetto a LM Studio, in quanto non dispone di una propria interfaccia grafica. Una GUI per FastFlowLM può essere ottenuta tramite Open WebUI. Altrimenti si utilizza tramite Windows PowerShell. Anche se potrebbe essere un'esperienza unica.

Per un confronto, abbiamo misurato il consumo energetico del computer portatile quando si utilizzava Gemma3:4b con LM Studio e FastFlowLM. Con FastFlowLM, l'assorbimento massimo di energia del portatile è stato di circa 25 watt. Significativamente più alto è stato il consumo di energia quando si è utilizzato lo stesso modello tramite LM Studio. Abbiamo misurato un consumo energetico di circa 65 watt. Entrambi i casi avevano comunque una velocità di uscita (in gettoni al secondo) notevolmente superiore a 10 gettoni al secondo. A seconda di come lo si calcola, Gemma3:4b raggiunge circa 250-600 parole al minuto con 10 tok/s. Come regola empirica, 1,8 token corrispondono a una parola tedesca, 1,3 token a una parola inglese. Abbiamo analizzato i testi tedeschi creati da Gemma e siamo arrivati a circa 450 parole al minuto. Il che è molto più veloce del lettore tipico.

Conclusione - L'intelligenza artificiale locale è possibile ma non sempre utilizzabile

Le funzioni AI di Windows funzionano perfettamente su Acer Swift Go 16 AI. Sorprendentemente, le risposte di SLM come Gemma3, Qwen3 e Granite 4 appaiono sullo schermo velocemente, ma con una qualità variabile a seconda del modello e dell'attività. Chi vuole assolutamente utilizzare i modelli Text2Image e altre funzioni di Amuse dovrebbe probabilmente optare per un computer portatile con più memoria. L'Acer Swift Go 16 AI Acer Swift Go 16 AI è disponibile anche con 32 GB di RAM.

In definitiva, l'AI è ancora agli inizi. Non esiste ancora un software facile da usare e che sfrutti le capacità della NPU AMD. È un peccato, perché le prestazioni che siamo stati in grado di ottenere con alcuni armeggi sono state particolarmente impressionanti. Anche Amuse mostra un potenziale promettente sul portatile, ma per i nostri gusti genera troppi messaggi di errore e a volte è piuttosto lento.

Lo dimostrano soprattutto i nostri test: Se vuole utilizzare le funzioni AI in modo efficace, ha bisogno di molta RAM veloce. La migliore AI è inutile se tutti gli altri programmi, come Word e i browser, si bloccano durante l'utilizzo delle funzioni AI.