DeepSeek V3.2 Exp AI LLM, gratuito e open-source, debutta con costi di calcolo più bassi, aiutando le aziende a risparmiare ancora di più

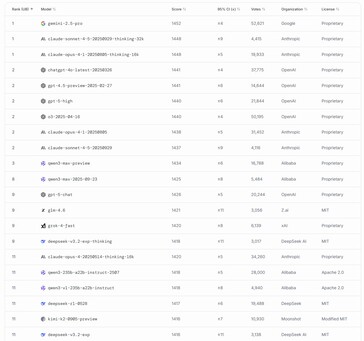

DeepSeek ha rilasciato il suo ultimo modello di intelligenza artificiale di grandi dimensioni, DeepSeek-V3.2-Exp, con costi di calcolo significativamente ridotti. Questa ottimizzazione aiuta le aziende che utilizzano l'API dell'azienda nelle loro applicazioni a risparmiare denaro, fornendo al contempo l'accesso a un'intelligenza artificiale intelligente, che si è classificata all'11° posto tra gli LLM più potenti rilasciati a livello mondiale.

Questo risultato è stato ottenuto utilizzando un nuovo design di DeepSeek Sparse Attention (DSA) per concentrarsi sull'indicizzazione dei token non con ogni altro token, come avviene con i trasformatori AI tradizionali, ma solo con quelli più rilevanti. Ciò consente all'AI di elaborare più velocemente il testo in ingresso fino alla sua finestra di 128K token, con un minore utilizzo di memoria.

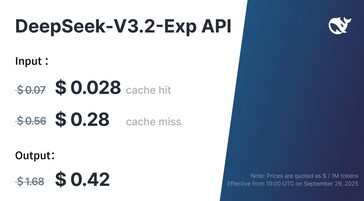

Gli sviluppatori di app che accedono a DeepSeek V3.2 Exp tramite la sua API pubblica possono aspettarsi di pagare oltre il 50% in meno rispetto alla versione precedente, pur mantenendo prestazioni paragonabili nei benchmark AI standardizzati.

L'AI LLM di da 400 GB può essere scaricato gratuitamente da Hugging Face e può essere eseguito localmente su computer potenti. I lettori che lo faranno avranno bisogno di un sistema con più GPU Nvidia H100/H200/H20 o un singolo server NVIDIA B200/GB200 come minimo, a causa dei requisiti di 1,5+ TB di VRAM del modello.

I lettori che desiderano eseguire DeepSeek v3.2 sui desktop domestici dovranno aspettare che i modelli quantizzati vengano rilasciati su Hugging Face, come questo per v3.1 di unslothe avere una GPU con almeno 24 GB di memoria, come questa Nvidia 5090 su Amazon.

I nostri Top 10

» Top 10 Portatili Multimedia

» Top 10 Portatili Gaming

» Top 10 Portatili Gaming Leggeri

» Top 10 Portatili da Ufficio e Business economici

» Top 10 Portatili Premium da Ufficio/Business

» Top 10 Portatili sotto i 300 Euro

» Top 10 Portatili sotto i 500 Euro

» Top 10 dei Portatili Workstation

» Top 10 Subnotebooks

» Top 10 Ultrabooks

» Top 10 Convertibili

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Smartphones